Les 10 et 11 février prochain, le Sommet pour l'action sur l'intelligence artificielle devrait réunir à Paris une centaine de chefs d'État et de gouvernements et plusieurs milliers de dirigeants d'organisations internationales, de petites et grandes entreprises, représentants du monde universitaire, chercheurs, organisations non-gouvernementales, artistes… La France veut ainsi provoquer une mobilisation internationale, ou du moins faire avancer la réflexion sur cinq thèmes. Elle veut “bâtir un consensus international sur un socle commun de gouvernance internationale de l’IA”, en avançant vers une “IA de confiance” sécurisée et une “infrastructure d’IA commune et ouverte, de l'accès aux données et à la puissance de calcul jusqu'au développement de modèles à faible consommation d'énergie”, au service du bien public. Elle compte également faciliter des échanges internationaux sur l’avenir du travail et les problématiques de création et de propriété intellectuelle.

Une coopération internationale essentielle

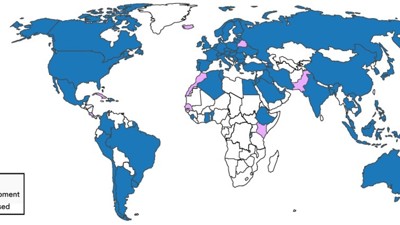

Jusqu’à présent, la réglementation de l’IA dans le monde a été largement fragmentée et inadaptée. Seuls 75 pays dans le monde disposent d’une stratégie nationale dédiée à l’IA, selon l’institut HAI de Stanford. Ces normes sont souvent limitées à des secteurs spécifiques comme la santé ou la finance, ignorant les impacts transversaux de l’IA, qui touchent des domaines aussi variés que l’éducation, la justice ou la défense.

Nombre de projets de loi relatifs à l'IA adoptés dans certains pays entre 2016 et 2023 • Source : AI Index - HAI Stanford

Les gouvernements nationaux manquent cruellement de compétences pour évaluer et encadrer l’IA. Selon le rapport tout récent du HAI de Stanford, moins de 10 % des décideurs publics déclarent comprendre les mécanismes de l’IA. Cela expose les États à une dépendance excessive envers les entreprises privées, qui deviennent les principaux arbitres des normes techniques.

Paradis IA et zizanie internationale

En outre, les disparités réglementaires entre pays créent des zones grises où des abus peuvent émerger. Les Caraïbes ont longtemps joué ce rôle pour les cryptos, permettant à Tether (et FTZ) de prospérer loin des regards des régulateurs financiers américain et européen. Dans l’IA, les modèles Llama de Meta ont été téléchargés plus de 600 millions rien que sur Hugging Face.

Une réglementation territoriale peut ainsi se retourner contre ses auteurs. En Europe, l’AI Act, qui propose un classement des systèmes d’IA par niveau de risque, a jusqu’à présent surtout eu pour effet de couper le continent d’une multitude de systèmes avancés, issus d’Apple, Google, Meta, OpenAI…

Il est probable qu’un des premiers assauts de l’administration Trump contre l’Europe portera précisément sur la réglementation du numérique, du RGPD à l’AI Act. On se souvient que l’éclat public, cet été, entre le commissaire européen Thierry Breton et celui qui n’était alors qu’un entrepreneur privé, Elon Musk, s’est conclu par le non-renouvellement du premier. Le rapport de forces entre les deux côtés de l’Atlantique ne semble pas destiné à beaucoup évoluer d’ici à février prochain.

Un éléphant dans la pièce, ça Trump énormément

Toutefois, l’administration Trump ne sera au pouvoir que depuis 20 jours, lors de l’ouverture du sommet. Et en 2022, une attaque utilisant un modèle génératif a ciblé des infrastructures critiques aux États-Unis, exposant l’importance d’une réponse internationale coordonnée. Une ouverture multilatérale sur un sujet technique comme l’IA est donc très improbable, mais pas entièrement impossible. Trump pourrait vouloir remplacer un accord de Paris sur le réchauffement climatique par son propre accord de Paris, sur l’IA.

De Sam Altman à Geoffrey Hinton, une part importante des experts américains de l’IA réclamait, au sommet de Bletchley Park notamment, la création d’une Agence pour l’IA similaire à l’Agence internationale pour l’énergie atomique (AIEA). Elle pourrait certifier les applications critiques, à l’instar des standards de sécurité aéronautique ou pharmaceutique, ou être chargée d’effectuer des audits algorithmiques réguliers sur les systèmes d’IA à haut risque, pour évaluer la conformité aux normes éthiques et de sécurité et d’assurer une certaine transparence des modèles, avec des exigences sur les données utilisées pour entraîner les systèmes.

À tout le moins, on peut espérer que les États-Unis participent à l’élaboration d’une IA de confiance, avec des protocoles de cybersécurité mondiaux, essentiels pour prévenir les risques liés à la manipulation de modèles d’IA dans des contextes sensibles, et surtout des standards communs pour les applications militaires de l’IA (dans les armements autonomes notamment).

Et peut-être même une avancée sur les droits d’auteur.

Jean Rognetta et Maurice de Rambuteau

Pour en savoir plus :