Dans son rapport sur les principaux risques de 2025, l’Eurasia Group, un think tank axé sur les risques géopolitiques, cite l’IA au même titre que l’Iran, la Russie et Donald Trump. Il note en effet que les modèles d'IA les plus récents se rapprochent des performances humaines dans plusieurs domaines, ce qui augmente l'urgence de prendre en compte les risques associés.

Agents malveillants

Ces dangers comprennent notamment la possibilité d'accidents catastrophiques ou d'une perte de contrôle des systèmes d'IA, ainsi que des problèmes de biais et de discrimination dans les décisions algorithmiques. La complexité grandissante des modèles d'IA crée également un défi de transparence, tandis que leur contrôle et leur alignement avec les objectifs humains deviennent de plus en plus difficiles à garantir. Ces préoccupations sont amplifiées par les risques d'utilisation malveillante de l'IA, comme la création de deepfakes ou les cyberattaques.

Pour ces dernières, Goldilock, une entreprise britannique spécialisée dans la cybersécurité des infrastructures critiques et soutenue par l’Otan, prévoit que les malwares "agentiques" deviendront une réalité d’ici deux ans. Ces logiciels malveillants, capables d’apprendre et de s’adapter de manière autonome, pourront non seulement éviter la détection, mais également cibler automatiquement de nouveaux systèmes en exploitant leurs vulnérabilités.

Déjà, la démocratisation de l’intelligence artificielle a permis à des acteurs étatiques et non étatiques d’exploiter des algorithmes existants pour créer des armes numériques sophistiquées. Un parallèle est souvent établi avec Stuxnet, un ver informatique découvert en 2010, attribué à une collaboration entre les États-Unis et Israël. Ce programme avait été conçu pour cibler les centrifugeuses iraniennes en exploitant des vulnérabilités des systèmes Siemens. Cependant, les malwares alimentés par l’IA pourront aller bien au-delà : ils seraient capables d’évoluer dynamiquement pour contourner des mécanismes de sécurité en temps réel, rendant leur neutralisation particulièrement difficile.

Les infrastructures critiques dans le viseur

D’après le rapport de Goldilock, les infrastructures critiques – réseaux électriques, systèmes de transport, institutions financières et hôpitaux – figurent parmi les cibles prioritaires. Ces secteurs, souvent caractérisés par une gestion technologique hétérogène ou obsolète, sont particulièrement exposés à des attaques visant à semer le chaos. Une interruption ciblée de l’approvisionnement énergétique ou des services hospitaliers pourrait entraîner des conséquences dramatiques pour la société.

Goldilock souligne également l’impact des tensions géopolitiques. Par exemple, la montée des tensions autour de Taïwan, avec la possibilité d’une intervention militaire chinoise d’ici 2027, crée un environnement propice au développement d’armes cybernétiques avancées. Ces outils, souvent mis au point par des États, pourraient être déployés non seulement pour des actes de sabotage, mais également pour des opérations d’espionnage à grande échelle.

Des failles dans la cybersécurité actuelle

Dans un rapport de l’Eurasia Group, un think tank axé sur les risques géopolitiques et technologiques, les auteurs insistent sur les lacunes des systèmes de cybersécurité existants face à ces nouvelles menaces. Les solutions actuelles, principalement réactives, ne suffisent pas à contrer des programmes capables d’évoluer en temps réel. Les infrastructures critiques, souvent sous-financées ou gérées par des entreprises privées, peinent à adopter des technologies de pointe, ce qui les rend particulièrement vulnérables. Le rapport de Goldilock souligne que la démocratisation de l’intelligence artificielle a permis à des acteurs étatiques et non étatiques d’exploiter des algorithmes existants pour créer des armes numériques sophistiquées.

Pour contrer ces menaces, Goldilock propose des solutions structurelles, comme la segmentation des réseaux. Cette approche consiste à isoler les différentes parties d’un système informatique afin de limiter la propagation des malwares en cas d’intrusion. Goldilock a développé un “interrupteur de sécurité” permettant de déconnecter à distance des serveurs critiques dès qu’une menace est détectée. Cette technologie évite les interventions manuelles, souvent longues et coûteuses, nécessaires dans des installations comme les centrales électriques.

Le rapport de Goldilock recommande également une collaboration accrue entre les secteurs public et privé pour partager des informations sur les cybermenaces en temps réel. Un tel modèle de transparence pourrait permettre une détection et une neutralisation plus rapides des menaces émergentes.

L’urgence d’une régulation internationale

L’analyse de l’Eurasia Group va plus loin, en soulignant l’absence de régulation internationale concernant l’utilisation de l’intelligence artificielle dans le domaine de la cybersécurité. Les gouvernements et entreprises doivent non seulement adopter des outils de détection basés sur l’IA, mais aussi développer des cadres juridiques clairs pour encadrer leur usage. Cela inclut notamment des normes sur le développement et l’emploi de malwares autonomes, qui posent des questions éthiques et politiques complexes.

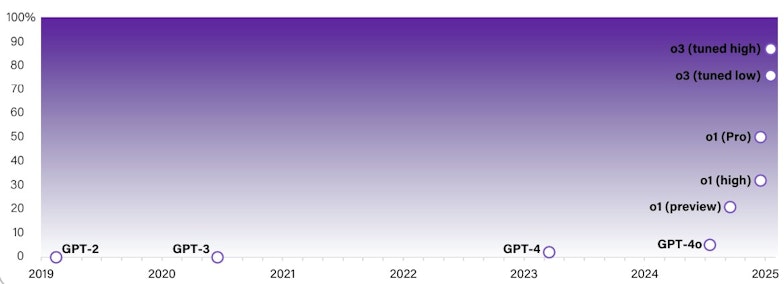

Les derniers modèles d'OpenAI s'approchent des performances humaines par rapport à des critères de référence • Source : Arc Prize, Eurasia Group

Sans un cadre juridique global, les grandes puissances pourraient s’engager dans une course technologique où les armes numériques deviennent des outils de déstabilisation géopolitique. Les auteurs du rapport recommandent des efforts concertés pour renforcer les normes internationales avant que ces menaces ne deviennent ingérables.

Une fenêtre d’action limitée

Les rapports de Goldilock et de l’Eurasia Group convergent sur un point : le monde dispose d’environ deux ans pour développer des solutions efficaces contre les malwares alimentés par l’IA. Les infrastructures critiques doivent adopter des mesures de cybersécurité avancées, comme la segmentation des réseaux et l’utilisation d’outils d’intelligence artificielle pour la détection des menaces. Cependant, ces efforts nécessitent une coopération internationale et des investissements significatifs pour être pleinement efficaces.

Pour en savoir plus :