"Ah, se lamentait le poète anglais George Meredith il y a plus de 150 ans, quelle réponse poussiéreuse obtient l'âme lorsqu'elle cherche des certitudes dans notre vie !" Ce sentiment est au cœur de deux livres récents qui offrent des perspectives uniques sur le défi existentiel que représente la vie à une époque d'incertitude accrue.

Naviguer dans l’incertain

Pour faire face à la complexité de naviguer dans un monde de plus en plus incertain, David Spiegelhalter et Neil D. Lawrence, tous deux de l'université de Cambridge, s'appuient largement sur leur vaste expérience professionnelle au sein et en dehors du monde universitaire. Spiegelhalter, professeur émérite de statistiques, a passé des années au sein de l'unité de biostatistique du Conseil de la recherche médicale du Royaume-Uni, et joué un rôle de premier plan dans plusieurs enquêtes publiques très médiatisées. Lawrence, professeur d'apprentissage automatique, a travaillé comme ingénieur de forage sur une plateforme de forage en mer du Nord avant de terminer son doctorat, de rejoindre Amazon en tant que directeur de l'apprentissage automatique et, enfin, de retourner dans le monde universitaire.

Le parcours des auteurs enrichit leur analyse des multiples façons dont l'humanité a cherché à mesurer et à gérer l'incertitude, depuis les approches fréquentistes - plus efficaces lorsque le risque peut être défini physiquement - jusqu'à l'analyse bayésienne, qui incorpore des estimations subjectives du risque. Malgré des différences de structure, de style et d'accent, leurs ouvrages convergent vers plusieurs thèmes clés.

La transparence intelligente

Un thème commun est la capacité de confiance propre à l'être humain et le rôle central des relations réciproques. Spiegelhalter, par exemple, s'appuie sur le concept de « transparence intelligente » de la philosophe Onora O'Neill pour illustrer la manière dont les décideurs politiques peuvent favoriser la confiance face à l'incertitude. De même, Lawrence cite les conférences Reith de 2002 de la BBC, dans lesquelles O'Neill affirme que la confiance n'est pas intrinsèque aux systèmes – qu'ils soient juridiques, politiques ou sociaux – mais qu'elle doit être gagnée par les personnes qui agissent en leur sein.

Un autre thème majeur est la montée en puissance de l'intelligence artificielle générative, en particulier des grands modèles de langage (LLM), qui font l'objet d'un débat intense et souvent hyperbolique depuis le lancement de ChatGPT à la fin de l'année 2022. En traitant de vastes réservoirs de contenus créés par l'homme pour générer des réponses textuelles et visuelles, ces systèmes sont apparemment conçus pour inspirer la confiance. Mais si, comme l'affirme O'Neill, les processus dépourvus de supervision humaine ne sont pas intrinsèquement dignes de confiance, comment pouvons-nous faire confiance aux algorithmes exploités par des machines ? Cette question, centrale dans le livre de Lawrence, apparaît également dans les dernières pages de celui de Spiegelhalter.

L’effet du passé et la cause de l’avenir

Enfin, Spiegelhalter et Lawrence invoquent tous deux la célèbre expérience de pensée connue sous le nom de « démon de Laplace », qu'ils considèrent comme une image miroir de l'imprévisibilité qui définit notre monde. Dans son ouvrage de 1814 intitulé Essai philosophique sur les probabilités, le philosophe Pierre Simon Laplace écrit :

« Nous pouvons considérer l'état actuel de l'univers comme l'effet de son passé et la cause de son avenir. Une intelligence qui connaîtrait à un moment donné toutes les forces qui mettent la nature en mouvement, et toutes les positions de tous les objets dont la nature est composée, si cette intelligence était aussi assez vaste pour soumettre ces données à l'analyse, elle embrasserait dans une seule formule les mouvements des plus grands corps de l'univers et ceux du plus petit atome ; pour une telle intelligence, rien ne serait incertain, et l'avenir comme le passé serait présent à ses yeux. »

La conscience de l’ignorance

À bien des égards, les livres de Spiegelhalter et de Lawrence constituent un contrepoint à l'univers déterministe imaginé par Laplace. Alors que le démon de Laplace représente l'omniscience et la prévisibilité parfaite, notre réalité est façonnée par des incertitudes inévitables, que Lawrence décrit avec justesse comme le « gremlin de Laplace ». Malgré tous nos efforts pour mettre au point des outils permettant d'atténuer les effets du hasard, de la chance et de l'ignorance, ces forces restent un élément incontournable de la vie quotidienne.

L'ouvrage de Spiegelhalter intitulé « L'art de l'incertitude » offre un compte rendu magistral des efforts déployés par l'humanité pour appliquer la théorie des probabilités à la prédiction. Selon lui, les probabilités ne sont pas des entités objectives et indépendantes qui attendent d'être découvertes. Au contraire, notre relation avec l'incertitude est profondément personnelle, façonnée par l'expérience, les ressources et d'autres facteurs qui influencent la façon dont nous percevons et abordons un problème donné. Comme il le dit, l'incertitude est la « conscience de l'ignorance ».

Entre aléatoire et épistémique

Prenons, par exemple, le simple fait de tirer à pile ou face une pièce de monnaie et de la couvrir avec la main. Ce scénario, explique Spiegelhalter, implique deux types distincts d'incertitude : aléatoire, qui reflète le caractère inhérent à un événement (ici, un jeu de pile ou face), et épistémique, qui découle d'un manque de connaissances sur un événement qui s'est déjà produit (si la pièce est tombée sur pile ou sur face).

Spiegelhalter utilise l'exemple du jeu de la pièce pour illustrer comment l'analyse statistique des expériences passées peut réduire l'éventail des résultats possibles dans des situations moins structurées. Si ce processus peut être simple en utilisant des méthodes fréquentistes, comme le calcul de la probabilité qu'un dé à six faces tombe sur un nombre spécifique, il devient beaucoup plus difficile lorsque les résultats ne sont pas clairement définis par des contraintes physiques.

L’impossible représentation de la réalité

Explorant le concept d'incertitude du modèle, Spiegelhalter souligne que nos modèles du monde, comme les cartes, sont des abstractions utiles mais jamais des représentations complètes de la réalité. Bien que certains soient plus précis que d'autres, aucun modèle ne peut être « vrai » au sens métaphysique du terme, en particulier lorsqu'il s'agit de modèles qui tentent de rendre compte du comportement humain.

La théorie des jeux a ajouté de la rigueur à cette analyse, en reconnaissant que les êtres humains réagissent non seulement aux actions des autres, mais aussi à leurs attentes par rapport à ces actions. Mais, comme l'a théorisé et démontré le financier George Soros, un comportement consciemment réfléchi crée une boucle récursive qui repousse les limites de notre capacité de prédiction.

De Spiegelhalter à Enigma

Spiegelhalter souligne à juste titre le rôle central du théorème de Bayes dans le développement de la théorie des probabilités. Formulé par le pasteur anglais Thomas Bayes et publié à titre posthume en 1763, il n'a été largement reconnu qu'après qu'Alan Turing et son équipe se sont appuyés sur lui pour déchiffrer le code allemand Enigma pendant la Seconde Guerre mondiale.

Le théorème de Bayes formalise l'analyse de l'incertitude en établissant un lien entre la probabilité a priori – la probabilité du résultat A, compte tenu de la preuve B – et la probabilité que la preuve soit observée compte tenu du résultat (la probabilité de la preuve B, compte tenu du résultat A), sous réserve de la probabilité indépendante d'observer séparément le résultat et la preuve. Le résultat de l'exercice est la probabilité postérieure, qui résume l'analyse et doit être mise à jour au fur et à mesure de la découverte de nouvelles preuves.

Apprivoiser l’incertitude

Pour donner vie au théorème de Bayes, Spiegelhalter présente aux lecteurs une série de questions qui incitent à la réflexion. Par exemple, pourquoi davantage de personnes vaccinées meurent-elles du Covid-19 que de personnes non vaccinées ? Et quelles sont les chances qu'une personne repérée par un logiciel d'imagerie policière moins que parfait représente réellement une menace ?

En guidant les lecteurs à travers les mécanismes de l'analyse bayésienne, Spiegelhalter ne se contente pas de la démystifier, il souligne également le rôle des attentes subjectives dans l'évaluation des preuves, en particulier lorsque les probabilités ne sont pas fonction de propriétés physiques (comme celles d'une pièce de monnaie ou d'un dé).

En fin de compte, comme le reconnaît Spiegelhalter, notre capacité à apprivoiser l'incertitude est limitée. Cette idée sous-tend également la règle de Cromwell, qui met en garde contre l'attribution d'une probabilité de zéro ou de un, à moins que l'on puisse démontrer logiquement que quelque chose est faux ou vrai. Nommée par le statisticien Dennis Lindley, cette règle s'inspire de l'appel lancé en 1650 par Oliver Cromwell à l'assemblée générale de l'Église d'Écosse : « Je vous prie, dans les entrailles du Christ, d'envisager que vous puissiez vous tromper ». Elle rappelle qu'en dehors du « petit monde » de la logique formelle, il y a toujours place pour le doute et la réévaluation.

Vers une incertitude radicale ?

Tout en reconnaissant les limites de la compréhension humaine, Spiegelhalter rejette fermement la notion d'incertitude radicale avancée par Frank Knight et John Maynard Keynes. L'idée que « nous ne savons tout simplement pas », comme l'a succinctement exprimé Keynes en 1937, s'est imposée avant que les estimations de probabilités subjectives ne soient largement acceptées.

Mais après avoir rejeté Knight et Keynes, Spiegelhalter n'est guère rassurant. Sa « conclusion personnelle » souligne les limites de l'analyse formelle : « Au fur et à mesure que nous reconnaissons une incertitude plus profonde, ontologique, où nous ne sommes même pas sûrs de pouvoir énumérer ce qui pourrait arriver, nous nous éloignons des tentatives d'analyse formelle et nous nous orientons vers une stratégie qui devrait être raisonnablement performante à la fois dans les situations que nous avons imaginées et dans celles que nous n'avons pas imaginées ».

L’inévitable hasard

Cette incertitude ontologique est inextricablement liée à la nature fondamentale du monde et de l'univers dans lesquels nous vivons. Comme l'indique la deuxième loi de la thermodynamique, dans un système fermé, l'ordre cède inévitablement la place au hasard.

La reconnaissance du fait que même nos systèmes et institutions les plus soigneusement construits restent vulnérables aux chocs imprévisibles relie L'art de l'incertitude à The Atomic Human de Lawrence. Comme l'observe Lawrence, « l'intelligence naturelle de l'homme a émergé dans un monde où elle était constamment mise à l'épreuve de l'inattendu ».

Notre adaptabilité et notre capacité de confiance réciproque font partie intégrante de ce que Lawrence appelle « l'homme atomique ». Ce concept est la réponse de Lawrence à la question centrale qui sous-tend sa perspicace histoire de l'IA : existe-t-il une essence humaine que les machines ne pourront jamais reproduire ?

L’exemple d’Eisenhower

Maître conteur, Lawrence utilise l'exemple du général Dwight Eisenhower, commandant des forces alliées en Europe et futur président des États-Unis. La veille du jour J, Eisenhower a dû faire la synthèse de tous les renseignements dont il disposait, puis s'en remettre à son propre jugement – ou, comme le dirait Spiegelhalter, à sa relation personnelle avec l'incertitude – pour décider de lancer ou non l'invasion de l'Europe occupée par les nazis. Après avoir donné l'ordre, Eisenhower rédigea un mémorandum dans lequel il acceptait l'entière responsabilité en cas d'échec de l'opération Overlord. Dans le récit de Lawrence, ce moment illustre la capacité de l'homme atomique à réfléchir à un avenir qu'il ne peut pas prévoir.

Parmi les ressources à la disposition d'Eisenhower figuraient les décryptages des codes allemands, décryptés par Turing et son équipe de décrypteurs. Lawrence utilise leurs efforts pour décrypter les machines de cryptage de plus en plus complexes de l'Allemagne nazie comme point de départ pour explorer l'histoire de l'informatique et, plus particulièrement, la quête pour développer des ordinateurs capables d'une véritable intelligence.

Et l’IA dans tout ça ?

En retraçant l'évolution de l'informatique depuis la cybernétique et les « systèmes experts » jusqu'à l'IA générative, les réseaux neuronaux et l'apprentissage automatique, Lawrence se concentre sur les travaux scientifiques qui ont façonné ces développements pour montrer comment les progrès des concepts informatiques ont dépendu des percées technologiques correspondantes. Il a notamment fallu deux générations d'innovations pour passer du perceptron de la fin des années 1950 – le premier système capable d'interpréter une image numérisée –- aux LLM d'aujourd'hui, qui utilisent une architecture similaire mais s'appuient sur des capacités rendues possibles par des systèmes beaucoup plus puissants.

La plus grande force de The Atomic Human réside dans la capacité de Lawrence à mêler l'histoire de la technologie à une exploration profonde de l'intelligence humaine. Notre intelligence, explique-t-il, a évolué grâce à la sélection naturelle, incarnant la persistance et l'adaptabilité inhérentes aux organismes façonnés par les processus évolutifs. En revanche, la sélection artificielle – qu'il s'agisse de cultures, d'animaux ou de systèmes informatiques – produit des espèces conçues à des fins spécifiques et susceptibles d'échouer lorsqu'elles sont confrontées à des conditions inattendues.

Une IA pas si “intelligente”

Lawrence met en contraste « l’immense pouvoir cognitif » de l'homme et le rythme remarquablement lent auquel nous communiquons nos connaissances. Notre capacité cognitive a évolué pour nous aider à survivre dans le monde imprévisible du « gremlin de Laplace », et nous partageons des récits pour donner un sens à ce que nous savons – ou que nous croyons – être vrai pour les autres. Reconnaissant que notre compréhension peut être imparfaite, nous nous remettons en question et développons des « théories de l'esprit », modélisant les pensées d'autres personnes pour compenser les limites inhérentes à la lenteur de la communication.

Les modèles d'IA actuels ne possèdent pas ces qualités essentielles de l'intelligence humaine. Lorsqu'ils sont confrontés à des conditions qui sortent du cadre de leurs données d'apprentissage, ils s'essoufflent. Néanmoins, ces modèles perpétuent ce que Lawrence appelle « la grande erreur de l'IA » : la croyance que nous avons créé une forme d'intelligence algorithmique qui nous comprend aussi profondément que nous nous comprenons les uns les autres.

En réalité, les LLM sont des machines de prédiction probabiliste. Comme l'explique l'informaticien Judea Pearl, grand spécialiste de la causalité, « les modèles d'apprentissage automatique nous offrent un moyen efficace de passer d'estimations d'échantillons finis à des distributions de probabilités, et nous devons encore parvenir à des relations de cause à effet ».

La chimère de l’IA omnisciente

Formés à partir de vastes quantités de contenus générés par l'homme et disponibles en ligne, les LLM traitent les expressions des tentatives de l'homme pour naviguer dans un monde incertain. Mais contrairement aux humains, ces systèmes n'ont aucune conscience de leurs propres déficiences. Par conséquent, leur remarquable capacité à s'appuyer sur des données d'apprentissage pour prédire le prochain mot d'un texte ou le prochain pixel d'une image est sujette à des erreurs qu'ils ne peuvent ni détecter ni corriger.

Lawrence envisage une hypothétique intelligence hybride issue de l'interaction entre un humain et une IA générative – une « machine humaine-analogique » (MAA), qu'il décrit comme un « bâton de commande pour la machine numérique ». Un tel système, suggère-t-il, pourrait augmenter et étendre les capacités humaines d'une manière que les LLM ne peuvent pas. Mais le risque de renforcer la « grande erreur de l'IA » reste toujours présent :

« Le danger auquel nous sommes confrontés est de croire que la machine nous permettra de transcender notre humanité. L'homme atomique se définit par ses vulnérabilités et non par ses capacités. Grâce à ces vulnérabilités, nous avons développé des cultures qui nous permettent de communiquer et de collaborer malgré ces limites. Tout au long de notre histoire, nous avons développé de nouveaux outils pour nous aider dans nos efforts, et l'ordinateur n'est que le plus récent. Mais l'ordinateur ne devrait jamais être autre chose qu'un outil ».

Au-delà de la donnée

Si Lawrence et Spiegelhalter célèbrent la capacité humaine à traiter les données pour prendre des décisions éclairées, ils soulignent également un défi fondamental : les données seules ne peuvent pas être porteuses de sens – le contexte est crucial.

L'utilisation croissante de l'IA pour recommander des peines criminelles et évaluer les demandes de libération conditionnelle aux États-Unis en est un bon exemple. Lorsque des systèmes de prédiction numériques sont introduits dans des environnements sociaux désordonnés, ils reflètent inévitablement les biais et les préjugés intégrés dans leurs données d'apprentissage.

Un défi encore plus grand réside dans l'incertitude ontologique que Spiegelhalter identifie comme l'un des moteurs des développements inattendus qui ont façonné l'intelligence humaine au cours de millions d'années. En d'autres termes, pouvons-nous faire confiance aux processus qui génèrent les données que nous observons pour qu'ils restent cohérents dans le temps ? Si ce n'est pas le cas, pouvons-nous leur faire confiance ?

Le passé peut-il prévoir l’avenir ?

L'économiste Paul Davidson a mis en lumière cette question dans son ouvrage de 2015 intitulé Post Keynesian Theory and Policy (Théorie et politique post-keynésiennes), en pointant du doigt une faille critique dans l'économie dominante : l'hypothèse selon laquelle les données passées peuvent être utilisées pour générer des distributions probabilistes qui restent stables dans le temps, ce qui permet d'établir des prévisions statistiquement fiables. « Puisqu'il est impossible de tirer un échantillon d'événements survenant dans le futur », observe Davidson, « l'hypothèse selon laquelle l'économie est régie par un processus stochastique ergodique permet à l'analyste d'affirmer que les échantillons tirés du passé ou des données actuelles du marché sont équivalents à des échantillons tirés des données futures du marché ».

Pour comprendre le problème que pose cette hypothèse, prenons l'exemple d'un jeune analyste financier d'une banque française en 1913, chargé de produire une prévision à cinq ans des prix des obligations russes. Pendant des décennies, la France a été une source majeure de capitaux pour la Russie tsariste, fournissant à notre analyste hypothétique de nombreuses données sur les prix des obligations russes. Ces données ont pu rendre compte de l'impact de la défaite de la Russie dans la guerre de 1905 contre le Japon, du soulèvement populaire qui s'en est suivi et de l'industrialisation progressive. Pour autant, une prévision aurait-elle pu anticiper le fait qu'en 1918, toutes les obligations russes ne vaudraient plus rien ?

L’incohérence de l’histoire

De même, la crise financière mondiale de 2008 a ébranlé la croyance de longue date selon laquelle l'incertitude était maîtrisée. Les stratégies de protection contre l'ignorance, telles que l'augmentation des exigences en matière de fonds propres des banques, sont rapidement devenues une priorité absolue. Ces réponses institutionnelles ont été conçues pour faire face aux crises passées et n'ont guère contribué à préparer les crises futures.

Lawrence identifie un autre défi : alors que « notre imagination fonctionne en tandem avec le monde qui l'entoure et s'appuie sur ce monde pour lui fournir la cohérence dont elle a besoin », l'histoire est tout sauf cohérente. Au contraire, elle est marquée par des perturbations, des changements de régime et des révolutions.

C'est dans cette optique que l'économiste Richard Zeckhauser a développé un modèle utile illustrant comment des niveaux de connaissance différents sur l'état du monde correspondent à des environnements d'investissement différents. Son modèle classe les scénarios de prise de décision en trois domaines distincts : le risque, l'incertitude et l'ignorance.

Le risque, l’incertitude et l’ignorance

Dans ce cadre, le « risque » se réfère à des situations où les états possibles du monde et leurs probabilités sont connus, de même que la distribution des rendements des investissements. En revanche, « l’incertitude » décrit des scénarios dans lesquels les états possibles du monde sont connus, mais pas leurs probabilités. Le troisième domaine, « l'ignorance », s'applique aux situations où même les états possibles du monde sont inconnus et où « les distributions des rendements sont conjecturées, souvent à partir de déductions sur le comportement des autres ».

Le concept d'ignorance de Zeckhauser fait écho à la notion d'incertitude de Keynes. En reconnaissant que notre ignorance prévaut souvent, nous comprenons que les résultats inconnus peuvent devenir des prophéties autoréalisatrices, motivées par un comportement grégaire de masse. Ainsi, comme dans la célèbre métaphore du concours de beauté de Keynes, nous observons attentivement les autres, dans l'espoir de ne pas être distancés ou piétinés.

Spiegelhalter le reconnaît lui-même : « Parfois, nous ne pouvons pas conceptualiser toutes les possibilités ». Parfois, « nous devons simplement admettre que nous ne savons pas ».

Pour en savoir plus :

- Onora 'Neill, Transparency and the ethics of communication, 2006

- Tulane University

- Richard Zeckhauser, Investing in the Unknown and Unknowable, Capitalism and Society, 2006

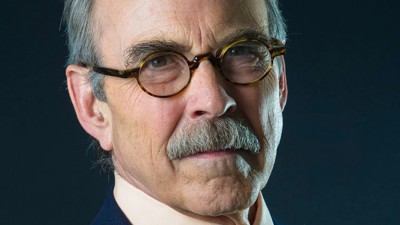

William H. Janeway est professeur en économie à l'Université de Cambridge et auteur de Doing Capitalism in the Innovation Economy (Cambridge University Press, 2018).

Ce texte a initialement été publié en anglais le 21 février sur Project Syndicate, traduction : Qant.

Qant est membre de Project Syndicate.